Snowflake Intelligence erklärt: KI-Agent, Governance und zuverlässige Antworten für Enterprise-Daten

Snowflake Intelligence einordnen: Warum ist das Thema gerade jetzt relevant?

Snowflake Intelligence ist der Enterprise-KI-Agent von Snowflake, der es erlaubt, Daten mit natürlicher Sprache zu analysieren. Statt SQL zu schreiben oder neue Dashboards anzufordern, stellst Du Fragen an Deine Daten – der Agent erzeugt Abfragen, wertet Ergebnisse aus und erklärt sie im Klartext.

Für mittelständische Unternehmen klingt das nach einer einfachen Lösung für überlastete BI-Teams und steigende Reporting-Anforderungen durch den Einsatz von Snowflake AI. Gleichzeitig verschärft ein solcher Agent aber bestehende Probleme, wenn Datenmodelle, Kennzahlen und Governance nicht sauber aufgesetzt sind.

Was ist Snowflake Intelligence? (kurz erklärt)

Snowflake Intelligence ist ein konversationelles Analyse-Erlebnis in der Snowflake-Plattform. Nutzer können Datenbestände in Snowflake per natürlicher Sprache befragen, bekommen Tabellen, Visualisierungen und erläuternde Texte zurück und können in einem Dialog mit den Snowflake Cortex Agents nachfragen.

Technisch nutzt Snowflake Intelligence KI-Modelle (über Snowflake Cortex), eine semantische Schicht (Semantic Views) und sogenannte Data Agents, die definierte Aufgaben ausführen, um Daten zu gewinnen. Wichtig: Der Agent arbeitet immer innerhalb der Snowflake-Governance, also mit Deinen bestehenden Rollen und Berechtigungen, und nutzt dabei die Snowflake Intelligence UI.

Warum Enterprise-KI-Agenten den BI-Markt verändern

KI-Agenten wie Snowflake Intelligence zielen darauf ab, den klassischen BI-Engpass zu entschärfen: Statt Tickets an das BI-Team zu stellen, soll der Fachbereich selbst Antworten bekommen. Das senkt die Einstiegshürde, erhöht aber gleichzeitig die Nutzung – und damit auch das Risiko für Fehlinterpretationen, die durch Cortex Analyst und Cortex Search minimiert werden können.

Gleichzeitig verschiebt sich der Fokus im BI-Markt: Weg von einzelnen Reports hin zu unternehmensweiten Datenräumen, semantischen Schichten und Governance-Regeln, die Self-Service und KI-Anwendungen kontrolliert ermöglichen. Wer diese Basis nicht hat, skaliert mit einem Agenten vor allem seine Unsicherheiten.

In der genannten Podcast-Folge wird Snowflake Intelligence aus Praxisperspektive beleuchtet: Welche Chancen bietet der Ansatz, „mit den Daten zu sprechen“, wo liegen Risiken und warum die Vorbereitung des Datenraums entscheidend ist. Der Podcast eignet sich gut, um Stakeholder aus Fachbereichen abzuholen und ein gemeinsames Verständnis dafür zu schaffen, dass KI-Agenten wie Snowflake Cortex Analyst die Bedeutung von Datenstrategie eher erhöhen als verringern.

Wie Snowflake Intelligence technisch arbeitet: Datenbasis, Cortex und Oberfläche

Um Snowflake Intelligence sinnvoll zu bewerten, hilft ein grober Blick auf die technische Architektur und die Rolle von Snowflake Cortex. Du musst die Komponenten nicht selbst implementieren können, solltest aber verstehen, wie sie zusammenspielen und an welchen Stellen zusätzlicher Aufwand entsteht.

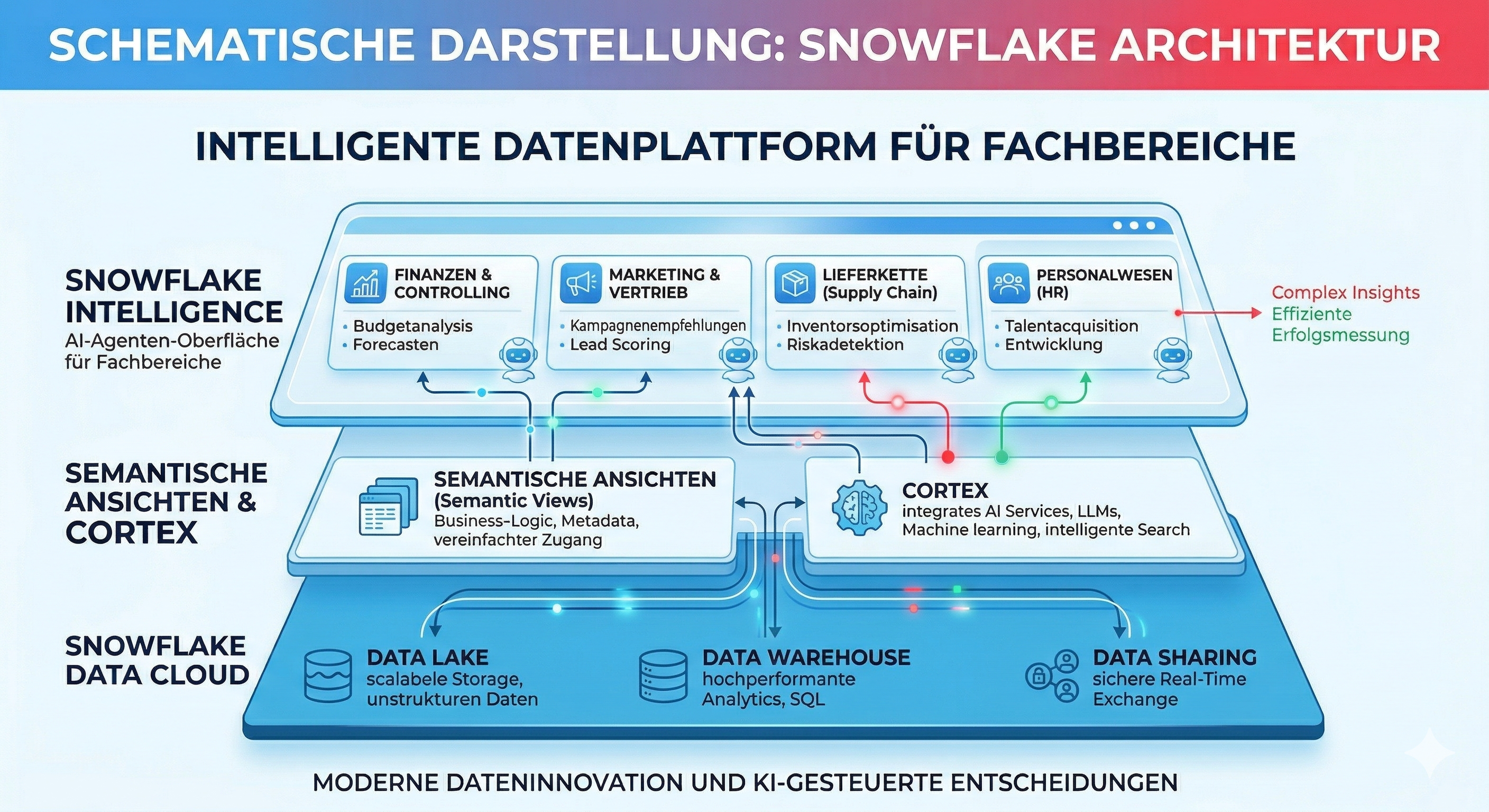

Auf hoher Ebene setzt sich das System aus drei Schichten zusammen: der Snowflake-Datenplattform, den KI- und Agent-Funktionen (Cortex, Data Agents) und dem Intelligence-Erlebnis als Oberfläche für Dialoge in natürlicher Sprache.

Architekturüberblick: Snowflake-Plattform, Cortex und Intelligence-Agent

Im Kern liegt die Snowflake-Plattform, die strukturierte und unstrukturierte Daten speichert, verarbeitet und über Rollen und Policies absichert, um die Governance und Sicherheit zu gewährleisten. Darauf aufbauend stellt Snowflake Cortex KI-Funktionen bereit, etwa Modellaufrufe, Vektor-Suche und Agent-Funktionalitäten.

Snowflake Intelligence nutzt diese Fähigkeiten und ergänzt sie um eine Dialogoberfläche, die mit agentenbasierter KI arbeitet. Der Agent kennt die zugrunde liegenden Semantic Views, Business-Begriffe und Policies und kann so Anfragen in verständliche Antworten übersetzen – inklusive Tabellen, Diagrammen und Erklärtexten, was die Nutzung von Snowflake Intelligence ermöglicht.

Natürliche Sprache zu Datenabfragen: Von der Frage zur Antwort

Wenn Du im Interface von Snowflake Intelligence eine Frage stellst, passiert im Hintergrund eine Abfolge von Schritten, die Deine Anfrage in eine Datenabfrage übersetzt. Zuerst analysiert ein Sprachmodell Deine Frage, erkennt relevante Begriffe, Kennzahlen, Filter und Zeitbezüge und ordnet sie den vorhandenen Semantic Views zu.

Dann erzeugt der Agent eine oder mehrere Abfragen gegen Deine Daten (typisch SQL oder AI-SQL), führt sie in Snowflake aus, bereitet die Ergebnisse auf und formuliert eine Antwort in natürlicher Sprache. Je nach Konfiguration ergänzt der Agent Visualisierungen oder weist auf Unsicherheiten hin, etwa bei dünner Datenbasis.

Rolle von Data Agents, Kontext und Wissensquellen

Data Agents in Snowflake sind spezialisierte „Rollen“ innerhalb des KI-Systems. Sie können auf bestimmte Datenbereiche oder Aufgaben fokussiert werden, etwa Vertriebsanalyse, Produktionskennzahlen oder Kosten- und Nutzungsreports zur Plattform, um Unternehmen dabei zu helfen, bessere Entscheidungen zu treffen.

Der Kontext, den ein Agent nutzt, stammt einerseits aus Deinen Datenmodellen und Semantic Views, andererseits aus zusätzlichen Wissensquellen wie Dokumenten oder Beschreibungen im Katalog. Je klarer Begriffe, KPIs und Beziehungen dort hinterlegt sind, desto gezielter kann der Agent Antworten liefern.

Sicherheits- und Governance-Bausteine in Snowflake Intelligence

Snowflake Intelligence greift auf bestehende Rollen, Berechtigungen und Policies in Snowflake zurück. Ein Nutzer sieht also nur die Daten, die er auch ohne KI-Agent sehen dürfte. Das ist ein wesentlicher Unterschied zu losgelösten KI-Chat-Lösungen mit separaten Datenkopien und unstrukturierten Daten.

Zusätzlich bietet Snowflake Mechanismen für Logging, Observability und Evaluierung von Antworten, die für die Entwicklung von AI Agents entscheidend sind. Damit können Data-Teams nachvollziehen, welche Fragen gestellt wurden, welche Abfragen der Agent ausgeführt hat und wie sich Kosten durch KI-Funktionen entwickeln.

Strategische Einordnung: Was Snowflake Intelligence verspricht und was Unternehmen mit Enterprise Intelligence Agenten daraus machen sollten

Technisch ist Snowflake Intelligence beeindruckend. Strategisch entscheidend ist aber, wie Unternehmen diese Funktionen einordnen und nutzen. Denn ein KI-Agent löst keine strukturellen Probleme in Deiner Datenlandschaft, sondern verstärkt sie – positiv wie negativ.

Die richtige Einordnung hilft Dir zu entscheiden, ob Snowflake Intelligence ein sinnvoller nächster Schritt ist oder ob zuerst Deine Datenstrategie und Datenbasis nachgezogen werden müssen, um die Integration von AI Agents zu ermöglichen.

Das Grundversprechen: Mit Daten in natürlicher Sprache sprechen

Das zentrale Versprechen lautet: „Frag Deine Daten so, wie Du mit einem Kollegen sprechen würdest.“ Damit zielt Snowflake Intelligence auf Fachanwender, die bisher vor SQL, DWH-Strukturen oder BI-Frontends zurückschrecken, aber dringend Antworten brauchen.

Für viele Use Cases – etwa Ad-hoc-Abweichungsanalysen, Rückfragen im Monatsabschluss oder schnelle Vertriebsfragen – ist dieses Versprechen attraktiv. Es reduziert Wartezeiten auf das BI-Team und macht vorhandene Datenbestände sichtbarer im Unternehmen, was die Nutzung von Cortex Knowledge Extensions erleichtert.

Demokratisierung von Datenzugriff: Entlastung von IT und BI-Teams

Wenn Fachbereiche einfache Fragen selbst klären können, sinkt die Zahl klassischer „Kannst Du mir mal schnell …?“–Tickets an BI und IT, und das Snowflake Intelligence hängt davon ab, wie gut diese Autonomie gefördert wird. Das schafft Freiraum für strukturelle Arbeiten an Datenmodellen, Qualität und Governance – vorausgesetzt, dieser Freiraum wird bewusst genutzt.

Gleichzeitig werden aber mehr Fragen gestellt, weil es bequemer ist. Das bedeutet mehr Abfragen, mehr Rechenlast und mehr potenzielle Interpretationen. Aus Sicht der Governance muss dieser zusätzliche Zugriff sauber gerahmt sein.

Bequemlichkeit vs. Belastbarkeit: Wo KI-Dialoge an Grenzen stoßen

Ein KI-Agent liefert in der Regel immer eine Antwort, die auf den ersten Blick überzeugend erscheint. Das fühlt sich komfortabel an, ist aber genau der kritische Punkt. Denn die Plausibilität einer Antwort sagt nichts darüber aus, ob Kennzahlen sauber definiert, Daten korrekt verknüpft oder Filter fachlich passend gesetzt sind.

Klassische Dashboards wirken im Vergleich manchmal „altmodisch“, sind aber häufig methodisch stabiler: Kennzahlen sind fix modelliert, Filter klar sichtbar, Berechnungen dokumentiert. Bei einem Agenten ist dieser Pfad ohne zusätzliche Maßnahmen schwieriger nachzuvollziehen, insbesondere wenn es um die Sicherheit und Governance der Daten geht.

Snowflake Intelligence ist kein Ersatz für Datenstrategie

Snowflake Intelligence kann eine gute Datenstrategie nicht ersetzen, sondern macht sie noch wichtiger. Ohne saubere Modellierung, klare KPI-Logik und abgestimmte Governance-Regeln entsteht nur ein komfortablerer Zugriff auf ein ohnehin unsauberes Datenbild.

Wenn heute schon Diskussionen über die ‚richtige‘ Umsatz- oder Margendefinition geführt werden, wird ein KI-Agent diese Diskussion nicht auflösen. Er beantwortet lediglich Fragen in natürlicher Sprache auf Basis der Definitionen, die Du ihm vorgibst – oder die ihm fehlen.

Kostenloses Erstgespräch vereinbaren

Warum die Datenbasis wichtiger ist als der KI-Agent: Schlechte Data Models machen Agents nicht zuverlässiger

Die technische Oberfläche von Snowflake Intelligence ist der sichtbare Teil, der durch die Funktionalitäten der Snowflake AI Data Cloud ergänzt wird. Der entscheidende Teil liegt darunter: Datenintegration, Modellierung, Historisierung, KPI-Definitionen und Berechtigungen. Hier entscheidet sich, ob Antworten nachvollziehbar und reproduzierbar sind.

Genau deshalb gilt: Wer über KI im BI-Kontext spricht, muss zuerst über Datenstrategie, Datenarchitektur und Governance sprechen – nicht über Chat-Interfaces.

Gute Antworten brauchen gute Datenräume: Integration, Modellierung, Governance

Ein KI-Agent kann nur so gut arbeiten, wie der Datenraum, auf den er zugreift, und die Qualität der bereitgestellten Informationen durch Enterprise Intelligence und die Snowflake Cortex Knowledge Extensions. Dazu gehören konsolidierte Daten aus ERP, CRM, Produktion und Finance, ein einheitliches Modell (z. B. Data Warehouse oder Lakehouse) und definierte Beziehungen zwischen Entitäten.

Ebenso wichtig ist Governance: Rollen und Berechtigungen, ein Datenkatalog mit Definitionen und eine gepflegte semantische Schicht, die Business-Begriffe auf technische Strukturen abbildet. Ohne diese Schicht bleibt der Agent im Blindflug.

Warum schlechte Datenmodelle durch KI plausibler – aber nicht richtiger – wirken

Ein klassisches Problem in BI-Projekten sind suboptimale Datenmodelle: zu komplex, inkonsistent oder historisch gewachsen, was die Implementierung von Cortex AI und den Einsatz von AI Agents erschwert. Mit einem KI-Agenten verschwinden diese Schwächen nicht, sie werden nur überdeckt, weil die Oberfläche plötzlich „smart“ wirkt, was durch die Snowflake AI Data Cloud unterstützt wird.

Die Gefahr: Vorher erkennbare Inkonsistenzen in Reports oder SQL-Abfragen werden durch natürlichsprachliche Antworten kaschiert. Fehlerhafte Joins, doppelt gezählte Umsätze oder falsch verstandene Zeitbezüge bleiben, wirken aber weniger offensichtlich.

Single Point of Truth statt Wildwuchs: Fachliche Definitionen vor Dialogkomfort

Bevor Du einen Agenten auf Deine Daten lässt, solltest Du klären, wo Dein Single Point of Truth liegt: Welche Tabelle oder Sicht gilt als führende Quelle für welche Kennzahl. Dazu gehört eine klare Definition von Feldern wie Umsatz, Marge, Kunde oder Projekt.

Diese Definitionen bilden später die Basis für Semantic Views und damit für Snowflake Intelligence. Wenn im Unternehmen kein Konsens herrscht, wird der Agent zwangsläufig unterschiedliche Erwartungen bedienen – und damit neue Verwirrung stiften.

Beispiele aus der Praxis: Wenn Self-Service-KI ohne Datenstrategie scheitert

In der Praxis sieht man häufig, dass Self-Service-BI oder KI-Funktionen eingeführt werden, bevor Datenmodelle stabil sind. Fachbereiche bauen eigene Auswertungen auf Exportdaten, die nicht mit zentralen Reports übereinstimmen, und ein KI-Agent amplifiziert diese Vielfalt.

Typische Folgen sind KPI-Diskussionen in Management-Meetings, nicht nachvollziehbare Abweichungen zwischen Report und Agenten-Antwort oder wechselnde Zahlen zu eigentlich identischen Fragen – ein massiver Vertrauensverlust in Daten insgesamt.

KI-Agent oder Dashboard: Warum zuverlässig oft wichtiger ist als bequem

Für viele BI-Teams stellt sich die Frage: Ersetzt ein KI-Agent langfristig klassische Dashboards oder ergänzen sich beide Ansätze. Die ehrliche Antwort lautet: Sie haben unterschiedliche Stärken und sollten bewusst kombiniert werden.

Der Schlüssel liegt darin, zu definieren, wann schnelle Exploration gewünscht ist und wann geprüfte, stabil definierte Kennzahlen im Vordergrund stehen müssen.

Stärken von KI-Agenten: Exploration, Ad-hoc-Fragen, Breitenzugriff

KI-Agenten wie Snowflake Intelligence sind stark in der explorativen Phase: „Warum ist der Absatz in Region Süd zurückgegangen?“, „Zeig mir auffällige Kunden mit negativer Marge“ oder „Welche Lieferanten haben ihre Termine im letzten Quartal am stärksten verfehlt?“.

Sie ermöglichen es, Hypothesen schnell zu prüfen, ohne neue Reports zu bauen. Das senkt die Hemmschwelle, Daten überhaupt zu nutzen, und hilft auch weniger datenaffinen Rollen, eigene Fragen in natürlicher Sprache zu formulieren.

Stärken von Dashboards: Stabil definierte Kennzahlen und klare Filterlogik

Dashboards glänzen dort, wo definierte Kennzahlen regelmäßig betrachtet werden: Monatsabschluss, Produktionskennzahlen, Vertriebs-Pipelines oder Service-Backlogs. Filter- und Drilldown-Logik sind festgelegt, Berechnungen dokumentiert und abgestimmt, sodass die Plattform von Snowflake optimal genutzt werden kann.

Für Audits, Compliance-Vorgaben oder Management-Entscheidungen mit hoher Tragweite sind solche stabilen, geprüften Sichten meist besser geeignet als spontane Agenten-Antworten, die sich von Frage zu Frage leicht unterscheiden können.

Wie sich beide Ansätze sinnvoll ergänzen können

Ein pragmatisches Modell sieht so aus: Dashboards liefern den „Single Point of Truth“ für zentrale KPIs, während der KI-Agent als Ergänzung für Rückfragen, Detailanalysen und Exploration dient. So behältst Du eine stabile Referenz und ermöglichst trotzdem flexible Analysen.

Im Idealfall greifen beide auf denselben Datenraum und dieselbe semantische Schicht zu, sodass Kennzahlen konsistent bleiben und zuverlässige Einblicke gewährt werden, die allgemein verfügbar sind, auch über den Snowflake Marketplace. Unterschiede in Ergebnissen werden so minimiert und sind leichter erklärbar, insbesondere durch die Funktionen von Snowflake.

Wann Du bei kritischen Entscheidungen nicht allein auf den Agenten vertrauen solltest

Für Budgetfreigaben, Investitionsentscheidungen, regulatorische Meldungen oder Berichte an Aufsichtsgremien solltest Du Dich nicht ausschließlich auf Agenten-Antworten stützen. Hier zählen Nachvollziehbarkeit, Revisionssicherheit und dokumentierte Berechnungslogik.

Eine praktikable Regel lautet: Nutze Snowflake Intelligence für Exploration und Hypothesenbildung, aber bestätige kritische Kennzahlen immer über etablierte, dokumentierte Reports oder durch das BI-Team – insbesondere, solange der Agent noch in der Einführungsphase ist.

| Einsatzsituation: Der Einsatz von Snowflake Cortex Agents kann die Effizienz in verschiedenen Szenarien erheblich steigern. | KI-Agent (Snowflake Intelligence) | Klassisches Dashboard |

|---|---|---|

| Ad-hoc-Fragen und spontane Analysen können durch die Nutzung von Fragen in natürlicher Sprache optimiert werden. | Sehr gut geeignet, schnelle Antworten in natürlicher Sprache. | Nur geeignet, wenn die Ansicht bereits existiert, um die Lücke zwischen Daten und Maßnahmen zu schließen. |

| Regelmäßiges Management-Reporting mit Unterstützung von Market Intelligence. | Ergänzend für Rückfragen nutzbar. | Bevorzugt, weil stabil und abgestimmt. |

| Auditierbare Kennzahlen (z. B. Finance) | Nur mit klarer Governance und zusätzlicher Prüfung, dass Snowflake Intelligence effektiv eingesetzt wird. | Bevorzugt, mit dokumentierter Logik, um geschäftlich relevante Entscheidungen zu unterstützen, die auf Market Intelligence basieren. |

| Hypothesenfindung, Mustererkennung | Stark, insbesondere in Kombination mit semantischer Schicht, um die Nutzung von Cortex Analyst und Cortex Search zu optimieren. | Limitierter, statischer Blick. |

Kostenloses Erstgespräch vereinbaren

Verantwortung im Umgang mit Snowflake Intelligence: Governance, vertrauenswürdige Zahlen und Enterprise-Risiken

Mit einem KI-Agenten ändert sich nicht nur die technische, sondern auch die organisatorische Situation. Wer trägt Verantwortung für Antworten, wer pflegt Semantik und Policies und wer entscheidet, welche Use Cases freigeschaltet werden.

Diese Fragen sind gerade im deutschen und europäischen Kontext entscheidend, weil Verantwortung rechtlich nicht an eine KI delegiert werden kann, was die Sicherheit und Governance betrifft.

Warum Verantwortung für Zahlen und Definitionen nicht an KI delegierbar ist

Auch wenn ein Agent Antworten generiert, bleibt die Verantwortung für Zahlen, Definitionen und Entscheidungen im Unternehmen. Du kannst Dich im Audit nicht darauf berufen, dass „die KI es so gesagt hat“. Grundlage sind immer Deine eigenen Definitionen und Daten.

Deshalb braucht es klare Regeln, welche Fragen der Agent beantworten darf, welche Datenräume er nutzen kann und wie Ergebnisse überprüft werden – insbesondere in regulierten Bereichen wie Finance, Healthcare oder kritischer Infrastruktur.

Rollen im Unternehmen: Data Owner, Governance, Fachbereiche

In einem KI-gestützten Analytics-Setup verändern sich bestehende Rollen und Verantwortlichkeiten. Data Owner verantworten Geschäftsobjekte und KPIs, das Governance-Team definiert Richtlinien und prüft Einhaltung, BI-Teams pflegen Modelle und Semantic Views.

Fachbereiche wiederum müssen befähigt werden, Antworten kritisch einzuordnen: Sie sollten verstehen, wann es sich um eine exakte Zahl handelt, wann um eine statistische Schätzung und wann Datenlücken oder Modellgrenzen eine Rolle spielen.

Typische Fehlinterpretationen und wie Du sie erkennst

Häufige Fehlinterpretationen entstehen, wenn aus Trendbeschreibungen harte Prognosen abgeleitet werden oder wenn Prozentabweichungen ohne Kenntnis der absoluten Basis interpretiert werden, was die Rolle von Cortex AI verstärken könnte. KI-Formulierungen verstärken das, weil sie sehr sicher klingen können, was die Demokratisierung von Daten fördert.

Ein guter Ansatz ist, Nutzer zu schulen, immer nach den zugrundeliegenden Daten zu fragen: „Zeig mir die Rohwerte“, „Welche Filter wurden verwendet?“ oder „Welche Definition von Marge nutzt Du hier?“. Ein guter Agent sollte solche Nachfragen unterstützen, insbesondere wenn es um komplexe Fragen in natürlicher Sprache geht.

Regulatorische und Compliance-Aspekte im deutschen/europäischen Umfeld

Der europäische AI Act verlangt für bestimmte KI-Systeme Transparenz, Nachvollziehbarkeit und Kontrollmechanismen, um die Nutzung von unstrukturierten Daten zu regulieren. Für analytische Agenten heißt das insbesondere: Logging, Versionierung von Modellen und klare Dokumentation von Datenquellen und Policies.

Zusätzlich bleiben DSGVO, branchenspezifische Vorgaben und interne Compliance-Regeln relevant. Snowflake bietet mit EU-Hosting und Governance-Funktionen die technischen Grundlagen, deren korrekte Konfiguration liegt aber bei Dir als Anwender.

Snowflake Intelligence in Deutschland nutzen: Sprache, Standort und Einsatzszenarien für Data Agents

Für Unternehmen im DACH-Raum stellen sich vor allem drei praktische Fragen: Kann der Agent auf Deutsch arbeiten, wo liegen die Daten und welche Anwendungsfälle lohnen sich tatsächlich in der eigenen Umgebung.

Hier hilft es, den Unterschied zwischen technischer Möglichkeit und organisatorischer Reife zu kennen – beides muss zusammenpassen, damit Snowflake Intelligence mehr Nutzen als Aufwand erzeugt und die Funktionen von Snowflake optimal genutzt werden können.

Kann Snowflake Intelligence auf Deutsch arbeiten – und was bedeutet das praktisch?

Snowflake Intelligence unterstützt natürlichsprachliche Interaktionen in mehreren Sprachen, darunter auch Deutsch, und bietet eine benutzerfreundliche Snowflake Intelligence UI, die den Zugriff auf strukturierte und unstrukturierte Datenquellen erleichtert. In der Praxis bedeutet das, dass Du Fragen, Filter und Erläuterungen auf Deutsch formulieren kannst, sofern die zugrunde liegenden Begriffe in der semantischen Schicht entsprechend gepflegt sind.

Gleichzeitig gilt: Feldnamen, Tabellen und KPIs stammen oft aus internationalen Systemen und sind englisch benannt. Entscheidend ist daher, dass Semantic Views und Kataloge eine klare Zuordnung zwischen fachlich deutscher Bezeichnung und technischer Implementierung herstellen.

Datenstandorte, Hosting-Optionen und Compliance-Anforderungen in Deutschland

Snowflake bietet Rechenzentrumsstandorte in der EU, sodass Datenhaltung in europäischen Jurisdiktionen möglich ist. Für viele mittelständische Unternehmen ist das ein wichtiger Punkt, um DSGVO- und Kundenvorgaben einzuhalten.

Wichtig ist, dass Du im Rahmen der Vertragsgestaltung und Konfiguration konkret festlegst, in welchen Regionen Daten verarbeitet werden dürfen und welche Verschlüsselungs- und Zugriffskonzepte gelten. Das gilt auch für KI-Funktionen, die zusätzliche Rechenressourcen nutzen.

Typische Anwendungsfälle im deutschen Mittelstand

Im Mittelstand sind vor allem Use Cases interessant, bei denen heute viele Rückfragen an BI-Teams gestellt werden: Abweichungsanalysen im Produktionscontrolling, Margenanalysen im Vertrieb, Reklamationsauswertungen im Qualitätswesen oder Kosten- und Nutzungsreports zur IT.

Snowflake Intelligence kann hier helfen, Standardfragen schneller zu beantworten, Muster zu erkennen und Hypothesen zu bilden. Voraussetzung ist aber, dass die zugrundeliegenden Prozesse und KPIs bereits definiert sind, sonst führt die neue Flexibilität schnell zu mehr Interpretationsspielraum.

Wie Unternehmen in Deutschland mit Snowflake Intelligence starten

Ein sinnvoller Startpunkt ist ein Pilot in einem klar abgegrenzten Bereich, etwa „Abweichungsanalysen im Monatsabschluss“ oder „OEE-Auswertungen für eine Produktionslinie“. So bleibt der Datenraum beherrschbar und die Effekte sind direkt messbar.

Parallel solltest Du Schulungen für ausgewählte Power-User einplanen, um sowohl fachliche als auch methodische Kompetenzen im Umgang mit einem KI-Agenten aufzubauen. Danach kann der Einsatz schrittweise auf weitere Bereiche ausgeweitet werden.

Wann Snowflake Intelligence für BI- und Data-Teams wirklich sinnvoll und vertrauenswürdig ist

Nicht jedes Unternehmen ist im selben Maß bereit für einen Enterprise-KI-Agenten wie Snowflake Cortex AI. Es lohnt sich, den eigenen Reifegrad ehrlich einzuschätzen, bevor Du Budget und Erwartungen an Snowflake Intelligence knüpfst.

Drei Ebenen sind besonders wichtig: Datenarchitektur, Datenqualität und organisatorische Verantwortung. Schwächen auf einer dieser Ebenen werden durch KI nicht behoben, sondern nur stärker sichtbar, insbesondere bei unstrukturierten Daten.

Reifegrad-Check: Wo steht Dein Unternehmen in Sachen Datenarchitektur?

Eine einfache Checkfrage ist: Gibt es heute bereits ein zentrales, dokumentiertes Datenmodell für Deine wichtigsten Kennzahlen – und gelten diese Zahlen im Unternehmen als verlässliche Grundlage? Wenn die Antwort „teilweise“ oder „nein“ lautet, sollte der Fokus zuerst auf Datenarchitektur liegen, um sicherzustellen, dass alle Maßnahmen ergriffen werden, um die Datenqualität zu verbessern.

Ebenso relevant ist, ob Du Datenflüsse, Historisierung und Berechtigungen heute schon weitgehend automatisiert betreibst oder ob viele Prozesse noch auf manuellen Exports und Excel-Auswertungen beruhen. Letzteres ist eine schwache Grundlage für KI-gestützte Self-Service-Analytics.

Must-haves vor dem Start: Datenqualität, Datenmodell, KPI-Logik

Vor dem Start mit Snowflake Intelligence solltest Du für den geplanten Use Case mindestens drei Dinge sauber definiert haben: eine zentrale Datenquelle oder einen konsistenten Datenraum, ein durchdachtes Datenmodell und eine abgestimmte KPI-Logik inklusive Definitionen.

Gerade bei Kennzahlen wie Umsatz, Marge, Deckungsbeitrag oder OEE ist es wichtig, dass alle Beteiligten dieselbe Logik meinen. Diese Definitionen gehören in Kataloge, Semantic Views und Dokumentation, damit der Agent sie nutzen kann und die Governance und Sicherheit gewährleistet sind, einschließlich Snowflake Intelligence.

Organisatorische Voraussetzungen: Prozesse, Verantwortlichkeiten, Schulung

Ein KI-Agent verändert die Art und Weise, wie Fachbereiche mit unstrukturierten Daten arbeiten, indem er die Möglichkeiten der Snowflake AI Data Cloud nutzt. Das erfordert klare Prozesse: Wer entscheidet über neue Use Cases, wer prüft Ergebnisse, wer pflegt semantische Definitionen und wer überwacht Kosten und Governance.

Schulungen sollten nicht nur die Bedienung der Oberfläche behandeln, sondern auch ein Grundverständnis für Datenmodelle, Filterlogik, Unsicherheiten und Grenzen von KI vermitteln, um die Demokratisierung von Daten zu fördern. So vermeidest Du, dass Agenten-Antworten unkritisch übernommen werden und sicherstellst, dass sie vertrauenswürdig sind, insbesondere im Hinblick auf Sicherheit und Governance.

Roadmap: Vom heutigen Reporting zur KI-gestützten Analytics-Landschaft

Eine praxisnahe Roadmap beginnt meist mit der Konsolidierung von Datenquellen und dem Aufbau eines stabilen Data Warehouse oder Lakehouse. Darauf aufbauend folgen semantische Schicht, KPI-Katalog und erste Self-Service-Dashboards, die auf der Snowflake AI Data Cloud basieren.

Wenn diese Grundlagen stehen, ist der Einstieg in Snowflake Intelligence ein sinnvoller nächster Schritt. Dann ergänzt der Agent eine bereits governte Landschaft, statt auf einem Flickenteppich aus Dateninseln zu landen.

Wie die bimanu Cloud Snowflake Intelligence vorbereitet und den Einsatz von Agents strukturiert ergänzt

Die bimanu Cloud ist kein KI-Chat-Frontend, sondern eine vollständig automatisierte Datenplattform, die genau die Strukturen schafft, die ein Agent wie Snowflake Intelligence benötigt, um komplexe Fragen in natürlicher Sprache zu beantworten. Sie kümmert sich um Integration, Modellierung, Governance und Betrieb Deines zentralen Datenraums, der für cortex agents optimiert ist.

Damit wird Snowflake Intelligence nicht zum Schnellschuss auf unsauberer Basis, sondern zur sinnvollen Erweiterung einer bereits belastbaren Datenarchitektur, die auch für geschäftliche Entscheidungen genutzt werden kann.

1. Saubere Datenräume als Fundament: Data Vault, Integration, Single Point of Truth

Die bimanu Cloud integriert Deine Vorsysteme über vorgefertigte Konnektoren und modelliert sie automatisiert in robusten Strukturen, etwa nach dem Data-Vault-Ansatz. So entsteht ein historisiertes, nachvollziehbares Datenfundament, das Änderungen und neue Quellen verträgt, um die Lücke zwischen Daten und Maßnahmen zu schließen.

Auf dieser Basis kannst Du einen Single Point of Truth für Deine Kernkennzahlen etablieren, unterstützt durch die Sicherheit und Governance der Snowflake AI Data Cloud und deren API. Snowflake Intelligence – oder andere KI- und BI-Tools – greifen dann auf sauber integrierte, harmonisierte Daten zu, statt auf einzelne Exporte oder fachbereichsspezifische Inseln.

2. Governance- und KPI-Schicht: Kennzahlen, Gültigkeitsbereiche, Data Lineage

Die bimanu Cloud bringt ein strukturiertes KPI-Management mit: Kennzahlen können mit Gültigkeitsbereichen, fachlichen Definitionen und technischen Berechnungsregeln versehen werden. Data Lineage macht transparent, woher eine Zahl stammt und welche Transformationen sie durchlaufen hat, was für die Sicherheit und Governance von entscheidender Bedeutung ist.

Genau diese Informationen sind im Zusammenspiel mit KI-Agenten entscheidend, weil sie helfen, Antworten zu prüfen und bei Bedarf bis zur Quelle zurückzuverfolgen, was durch Cortex Search erleichtert wird. Semantic Views in Snowflake können auf solchen klar definierten KPI-Strukturen aufbauen.

3. Kontrollierte Bereitstellungs- und Betriebsumgebung für KI-Use-Cases

Mit versioniertem Deployment, integriertem Monitoring, Alerting und einem fein granulierten Rollen- und Berechtigungssystem sorgt die bimanu Cloud dafür, dass Änderungen an Datenmodellen kontrolliert ausgerollt werden. Fehlerhafte Versionen lassen sich nachvollziehen und zurücknehmen, was die Sicherheit und Governance verbessert.

Für KI-nahe Use Cases ist das besonders wichtig: Wenn ein Agent auf modifizierte Strukturen zugreift, willst Du sicherstellen, dass diese Änderungen geprüft, dokumentiert und konsistent sind – sonst entstehen plötzlich abweichende Antworten für dieselbe Frage.

Mit einer Plattform wie bimanu den Datenraum für verlässliche KI-Antworten schaffen

Zusammengefasst: Snowflake Intelligence macht den Zugriff auf Daten einfacher und beschleunigt den Prozess, löst aber nicht die Aufgaben rund um Datenarchitektur, KPI-Definition und Governance. Genau hier setzt die bimanu Cloud an und schafft die Voraussetzungen, damit ein KI-Agent tatsächlich belastbare Antworten liefern kann, unterstützt durch die Snowflake AI Data Cloud.

Wenn Du bereits Snowflake im Einsatz hast oder planst, es zu nutzen, kann bimanu als vorgelagerte oder ergänzende Datenplattform dienen, um Datenräume sauber aufzubauen und dann gezielt in Snowflake, BI-Tools oder KI-Anwendungen bereitzustellen.

Kostenloses Erstgespräch vereinbaren

bimanu Cloud vs. klassische BI-Tools: Welche Unterschiede im Kontext von Snowflake Intelligence wirklich zählen

Häufig wird bimanu mit klassischen BI-Tools verglichen, obwohl es auch Funktionen von Snowflake Intelligence bietet, die diese Vergleiche herausfordern. In Wirklichkeit adressiert die Plattform eine andere Schicht: nicht die Visualisierung, sondern die Architektur und Automatisierung des Datenfundaments, auf dem BI-Tools und KI-Agenten aufsetzen.

Für Deine Entscheidungsfindung ist es wichtig zu verstehen, an welcher Stelle bimanu Mehrwert liefert und wie sich das von Frontend-Tools wie Power BI, Tableau oder Qlik unterscheidet.

Fokus auf Datenarchitektur statt nur Visualisierung

Klassische BI-Tools glänzen im Aufbau von Dashboards, Self-Service-Reports und Visualisierungen. Die Modellierung dahinter wird oft im jeweiligen Tool vorgenommen, was bei mehreren Frontends schnell zu Parallelmodellen und Inkonsistenzen führt.

Die bimanu Cloud legt den Schwerpunkt auf zentralisierte, modellgetriebene Datenarchitektur, um die Nutzung von AI Agents zu optimieren und innerhalb von Snowflake zu arbeiten. Sie generiert DWH-Strukturen automatisiert, historisiert Daten und macht sie über standardisierte Schnittstellen für beliebige BI-Tools und Plattformen wie Snowflake und die data cloud nutzbar.

Saubere KPI-Logik statt nur schöner Oberfläche

Ein häufiges Problem in BI-Landschaften sind Kennzahlen, die in verschiedenen Reports unterschiedlich berechnet werden. BI-Tools allein bieten selten eine zentrale Stelle, an der KPI-Definitionen samt Data Lineage verwaltet werden, was durch die AI Data Cloud verbessert werden kann.

Die bimanu Cloud adressiert genau das mit einem KPI- und Metadaten-Management, das fachliche und technische Definitionen zusammenführt. Für KI-Agenten wie Snowflake Intelligence ist das ein wesentlicher Vorteil, weil sie auf konsistent definierte Kennzahlen zugreifen können, die von Cortex Analyst analysiert werden.

Low-Code plus professionelle Modellierung für mittelständische Teams

Viele Mittelständler haben nicht die Ressourcen, um umfangreiche Data-Engineering-Teams aufzubauen. Gleichzeitig reicht eine rein klickbasierte Modellierung ohne Struktur in komplexen Umgebungen nicht aus.

bimanu kombiniert Low-Code-Ansätze mit professionellen Modellierungsmustern wie Data Vault. So lassen sich robuste Datenräume aufbauen, ohne dass jeder Schritt manuell programmiert werden muss – ein realistischer Weg, Datenarchitektur auf Mittelstandsniveau zu heben.

Offenes Frontend-Ökosystem: Tableau, Power BI, Qlik, Excel & Co.

Während manche Plattformen stark an ein bestimmtes Frontend gebunden sind, ist die bimanu Cloud bewusst offen gestaltet, um die Integration von Cortex Agents und Snowflake OpenFlow zu fördern. Die harmonisierten Daten können in Power BI, Tableau, Qlik, Snowflake oder auch Excel genutzt werden.

Das reduziert Vendor Lock-in und erlaubt Dir, bestehende Reporting- und Analytics-Tools weiterzuverwenden, während Du die Vorteile der data cloud nutzt. Snowflake Intelligence und klassische Dashboards können so parallel auf dieselbe Datenbasis zugreifen.

Kontrollierter Betrieb: Deployment, Monitoring, Rollen und Berechtigungen

Sobald BI- und KI-Anwendungen geschäftskritisch werden, reicht ein „Best-Effort“-Betrieb nicht mehr aus, um die Anforderungen an die Sicherheit und Governance zu erfüllen. Versionierung, Deployment-Pipelines, Monitoring und Alerts werden dann zu Pflicht.

Die bimanu Cloud bringt diese Betriebsaspekte mit, inklusive Entra-ID-Integration, Logging und Audit-Funktionen. Das schafft eine kontrollierte Umgebung, in der Datenänderungen nachvollziehbar bleiben – eine wichtige Grundlage, wenn später ein Agent automatisiert auf diese Daten zugreift, um geschäftliche Maßnahmen zu ergreifen.

Kosten- und Umsetzungstransparenz für den Mittelstand

Für mittelständische Unternehmen ist neben der Technik vor allem Planbarkeit wichtig: klare Paketstrukturen, begrenzter Beratungsaufwand und die Möglichkeit, vieles in Eigenregie zu betreiben, sobald die Grundlagen gelegt sind.

Im Vergleich zu rein projektgetriebenen Setups oder stark konsultinglastigen Plattformen legt bimanu Wert auf ein produktisiertes Angebot mit klarer Roadmap. Das senkt die Einstiegshürde in eine professionelle Datenarchitektur, die später auch KI-Anwendungen trägt.

| Aspekt | Klassisches BI-Tool | bimanu Cloud |

|---|---|---|

| Hauptfokus | Visualisierung, Self-Service-Reporting. | Datenintegration, Modellierung, Governance. |

| KPI-Definition | Oft im jeweiligen Report oder Dataset, das durch die Snowflake Cortex Knowledge Extensions angereichert wird. | Zentral gemanagt mit Gültigkeiten und Lineage. |

| Frontend-Abhängigkeit | An das jeweilige Tool gebunden. | Frontend-agnostisch, mehrere Tools parallel möglich, einschließlich Cortex Analyst und Cortex Search für eine umfassendere Analyse. |

| Eignung als Basis für KI-Agenten | Begrenzt, wenn keine zentrale Semantik existiert. | Hohe Eignung durch zentralisierte Daten- und KPI-Schicht. |

Vom BI-Engpass zum zuverlässigen Datenraum: Schritt für Schritt zur Grundlage für Snowflake Intelligence

Wenn Du heute unter einem BI-Engpass leidest und gleichzeitig das Potenzial von Snowflake Intelligence nutzen willst, lohnt sich ein strukturiertes Vorgehen. So vermeidest Du, dass der Agent nur kurzfristig Entlastung bringt und langfristig neue Komplexität erzeugt.

Die folgenden Schritte skizzieren einen pragmatischen Weg, wie Du Deine Datenlandschaft in überschaubaren Etappen in Richtung KI-Fähigkeit entwickelst.

Schritt 1: Datenquellen konsolidieren und modellgetrieben integrieren

Am Anfang steht die technische Hausaufgabe: Relevante Systeme wie ERP, CRM, MES, Shop oder Finance werden angebunden und in einem zentralen Datenraum konsolidiert. Statt direkt auf Rohtabellen zu setzen, solltest Du auf modellgetriebene Ansätze wie ein Data Warehouse setzen.

Mit der bimanu Cloud lässt sich dieser Schritt stark automatisieren: Konnektoren holen die Daten, Data-Vault-Strukturen werden generiert und ein einheitlicher Datenraum entsteht, der wachsen kann, ohne zum Flickenteppich zu werden.

Schritt 2: KPI-Set definieren und Governance-Verantwortung klären

Parallel definierst Du ein Set an Kernkennzahlen für Deinen ersten Use Case: Welche KPIs sind kritisch, wie werden sie berechnet, welche Dimensionen und Filter sind zulässig. Diese Definitionen sollten gemeinsam von Fachbereich, Finance/Controlling und BI abgestimmt werden, um die geschäftlichen Anforderungen optimal zu erfüllen.

Anschließend werden Verantwortlichkeiten festgelegt: Wer besitzt welche Kennzahl, wer entscheidet über Änderungen und wer pflegt die Dokumentation in den Workflows des zuverlässigen Enterprise Agents, um die geschäftlichen Anforderungen zu erfüllen. So entsteht eine Governance-Struktur, auf die KI-Agenten später aufsetzen können.

Schritt 3: Datenplattform automatisieren und Betriebsprozesse aufsetzen

Wenn Datenmodelle und KPIs stehen, geht es darum, die Plattform in den täglichen Betrieb zu überführen: automatische Beladungen, Monitoring, Alerts bei Fehlern oder Datenqualitätsproblemen und klare Deploymentschritte für Änderungen.

In der bimanu Cloud sind diese Betriebsprozesse Bestandteil der Plattform. Das entlastet Deine IT und sorgt dafür, dass der Datenraum stabil bleibt – eine Grundvoraussetzung für jede Form von Self-Service oder KI-Zugriff.

Schritt 4: Snowflake Intelligence für erste Use Cases anbinden

Auf dieser Basis kannst Du Snowflake Intelligence gezielt einsetzen. Zuerst für klar definierte Szenarien, etwa Abweichungsanalysen im Monatsabschluss oder Produktivitätsanalysen in einer Fertigungslinie.

Semantic Views in Snowflake werden auf die bestehenden Datenmodelle und KPI-Definitionen gemappt. So stellst Du sicher, dass der Agent auf dieselbe Wahrheit zugreift wie Deine Dashboards und Standardberichte, die durch die Governance und Sicherheit innerhalb von Snowflake unterstützt werden.

Schritt 5: Skalierung, Monitoring und kontinuierliche Verbesserung

Wenn erste Use Cases erfolgreich laufen, kannst Du Snowflake Intelligence schrittweise auf weitere Fachbereiche ausrollen. Wichtig ist, dass Du dabei Monitoring und Feedback ernst nimmst: Welche Fragen treten häufig auf, wo entstehen Missverständnisse, wie entwickeln sich Kosten und wie kann Snowflake erleichtert werden?

Auf dieser Basis passt Du Semantic Views, KPI-Definitionen und Governance-Regeln laufend an. So bleibt der Agent verlässlich, während Deine Datenlandschaft und Nutzung wachsen.

Snowflake Intelligence FAQ: Häufige Fragen zu Agent, Data Agents und vertrauenswürdiger Nutzung

Was ist Snowflake Intelligence in einfachen Worten erklärt?

Snowflake Intelligence ist ein KI-gestützter Assistent innerhalb der Snowflake-Datenplattform, mit dem Du Deine Unternehmensdaten in natürlicher Sprache abfragen kannst. Statt SQL zu schreiben oder ein neues Dashboard zu bauen, stellst Du eine Frage, und der Agent erzeugt passende Abfragen und erklärt die Ergebnisse, um komplexe Fragen in natürlicher Sprache zu beantworten.

Ist Snowflake Intelligence in Deutschland verfügbar und datenschutzkonform nutzbar?

Ja, Snowflake bietet Rechenzentrumsstandorte in der EU, und Snowflake Intelligence kann auf dieser Basis betrieben werden. Ob Dein Einsatz datenschutzkonform ist, hängt jedoch von konkreter Konfiguration, Datenkategorien und Vertragsgestaltung ab – insbesondere in Bezug auf DSGVO, Auftragsverarbeitung und interne Compliance-Regeln.

Kann Snowflake Intelligence auf Deutsch genutzt werden – und wie gut funktioniert die natürliche Sprache?

Snowflake Intelligence unterstützt deutschsprachige Eingaben, sofern Modelle und semantische Schicht entsprechend konfiguriert sind. In der Praxis solltest Du damit rechnen, dass eine Kombination aus deutschen und englischen Begriffen sinnvoll ist, weil viele technische Feldnamen englisch sind; entscheidend ist eine saubere Zuordnung in Semantic Views.

Wofür kann ich Snowflake Intelligence im Mittelstand konkret einsetzen?

Typische Einsatzfelder sind Ad-hoc-Abweichungsanalysen in Finance, OEE- und Ausschussanalysen in der Produktion, Margenanalysen im Vertrieb oder Auswertungen zur Lieferantenperformance im Einkauf. Überall dort, wo heute viele Rückfragen an BI-Teams gehen, kann ein Agent erste Antworten liefern und Hypothesen unterstützen, was durch die Plattform von Snowflake ermöglicht wird.

Ersetzt ein KI-Agent wie Snowflake Intelligence klassische Dashboards und BI-Reports?

Nein, er ergänzt sie. Dashboards bleiben wichtig für stabil definierte Kennzahlen, regelmäßiges Reporting und auditierbare Sichten. Snowflake Intelligence eignet sich besonders für Exploration, Rückfragen und Ad-hoc-Analysen; beides sollte auf derselben Datenbasis und KPI-Logik aufbauen, um die Effizienz von Enterprise Intelligence Agents zu steigern.

Wie stelle ich sicher, dass Antworten von Snowflake Intelligence fachlich korrekt und belastbar sind?

Die Grundlage ist ein sauber modellierter Datenraum mit klar definierten Kennzahlen, Semantic Views und Governance-Regeln. Zusätzlich solltest Du Stichproben mit bestehenden Reports vergleichen, Logging und Evaluierungen nutzen und Nutzer schulen, um die Herkunft und Definition von Zahlen kritisch zu hinterfragen.

Welche Voraussetzungen muss meine Datenlandschaft erfüllen, bevor ich Snowflake Intelligence einführe?

Du brauchst konsolidierte, integrierte Daten für den geplanten Use Case, ein durchdachtes Datenmodell und abgestimmte KPI-Definitionen. Außerdem sollten Rollen, Berechtigungen und grundlegende Governance-Regeln etabliert sein; wenn heute noch viel mit unverbundenen Excel-Exports gearbeitet wird, ist erst die Plattformbasis zu stärken.

Welche Rolle spielt eine Plattform wie bimanu im Zusammenspiel mit Snowflake und Snowflake Intelligence?

Die bimanu Cloud bereitet den Datenraum vor, auf dem Snowflake Intelligence sinnvoll arbeiten kann: Sie integriert Quellen, modelliert Daten, managt KPIs und sorgt für Governance und Betrieb. Snowflake kann darauf aufsetzen, sei es als DWH-, Analytics- oder KI-Schicht, ohne dass Du die gesamte Architektur selbst bauen musst.

Wie starte ich pragmatisch mit Snowflake Intelligence, ohne ein Großprojekt aufzusetzen?

Wähle einen klar abgegrenzten Use Case mit hohem Nutzen, etwa Abweichungsanalysen im Monatsabschluss, und bringe dort Datenmodell, KPIs und Governance auf einen sauberen Stand, um tiefgreifende Einblicke zu gewinnen. Dann implementierst Du Semantic Views in Snowflake, aktivierst Snowflake Intelligence für einen kleinen Nutzerkreis und baust auf deren Feedback die nächsten Schritte auf.

Wer trägt die Verantwortung, wenn Entscheidungen auf Basis von KI-Antworten getroffen werden?

Verantwortung bleibt immer beim Unternehmen und seinen Entscheidern, nicht beim KI-Anbieter, um vertrauenswürdige Entscheidungen zu gewährleisten. Deshalb brauchst Du klare Rollen, Prüfprozesse und Governance-Regeln, insbesondere für kritische Entscheidungen; KI-Agenten sind Werkzeuge, keine Entscheidungsträger, und müssen im Rahmen der Governance und Sicherheit agieren.